Wprowadzenie

W nowoczesnej inżynierii danych proces ETL (Extract, Transform, Load) stanowi kręgosłup każdej platformy analitycznej. To właśnie pipeline’y ETL decydują o tym, czy dane w hurtowni odzwierciedlają rzeczywistość biznesową, czy też stają się źródłem niekończących się incydentów i nocnych dyżurów inżynierów. Współczesne systemy rozproszone -z automatycznym skalowaniem, tymczasowymi procesami wywoływanymi na żądanie i częstymi wdrożeniami – generują dziesiątki potencjalnych punktów awarii, w których pojedyncza przerwa może zdublować transakcje finansowe lub trwale rozjechać spójność danych.

Kluczowym pojęciem, które odróżnia profesjonalne potoki danych od amatorskich, jest idempotentność – właściwość gwarantująca, że wielokrotne uruchomienie tej samej operacji z tym samym zestawem danych wejściowych prowadzi do identycznego stanu końcowego, bez duplikacji ani korupcji danych. Ten artykuł jest praktycznym przewodnikiem po projektowaniu odpornych pipeline’ów ETL – od architektury po konkretne wzorce implementacyjne i strategie testowania.

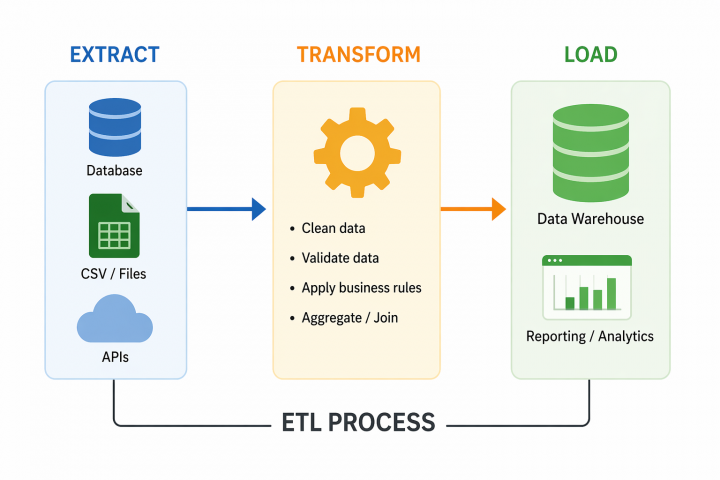

Czym jest ETL i gdzie znajduje zastosowanie

ETL to proces, w którym dane są pobierane ze źródeł (Extract), przekształcane do pożądanej struktury (Transform) i ładowane do systemu docelowego (Load). To fundament integracji danych w skali korporacyjnej.

Typowe obszary zastosowania pipeline’ów ETL obejmują:

- Hurtownie danych (Data Warehouses) – konsolidacja danych transakcyjnych z wielu systemów źródłowych do scentralizowanego magazynu analitycznego.

- Integracja systemów – synchronizacja danych między systemami CRM, ERP, platformami płatności i systemami marketingowymi.

- Migracje danych – jednorazowe lub powtarzalne przenoszenie danych między systemami, np. przy zmianie dostawcy bazy danych.

- Pipeline’y analityczne – przygotowanie danych pod modele machine learning, scoring ryzyka czy systemy fraud detection.

- Systemy BI (Business Intelligence) – zasilanie dashboardów i raportów.

Niezależnie od zastosowania, efekt braku idempotentności jest ten sam: zdublowane rekordy, przekłamane agregaty, dashboardy, którym nikt już nie wierzy, i godziny spędzone na ręcznym prostowaniu danych.

Architektura procesu ETL

Extract – pobieranie danych ze źródeł

Etap ekstrakcji to moment, w którym dane opuszczają system źródłowy. W zależności od architektury, dane mogą być pobierane w trybie batch (paczkami w określonych odstępach czasu) lub streaming (zdarzenie po zdarzeniu, niemal w czasie rzeczywistym).

Z perspektywy idempotentności kluczowe jest, aby już na tym etapie generować stabilne identyfikatory zdarzeń – najlepiej naturalne klucze biznesowe (np. order_id) lub deterministyczne hashe payloadu. Klucze powinny powstawać jak najbliżej źródła, ponieważ to one będą później decydować o deduplikacji w warstwach docelowych.

Transform – przekształcanie danych

Faza transformacji obejmuje czyszczenie, walidację, uzupełnianie i agregację danych. To również najczęstsze miejsce wprowadzania ukrytego niedeterminizmu – np. przez użycie funkcji zwracających aktualny czas systemowy czy samplingu bez ustalonego seeda.

Pipeline jest tak idempotentny, jak jego najsłabsze ogniwo. Jeśli wcześniejsze transformacje wprowadzają losowość, to nawet idealnie zaprojektowana sekcja ładowania nie zapewni pełnej deterministyczności wyniku. Dlatego transformacje powinny opierać się na logicznej dacie wykonania dostarczanej przez warstwę orkiestracji, nie na czasie systemowym.

Load – ładowanie do systemu docelowego

Ostatnia faza to zapis danych do hurtowni, lakehouse’a lub innego magazynu. To tutaj najczęściej powstają duplikaty – i to tutaj idempotentność ma największe znaczenie. Zamiast naiwnych operacji INSERT, profesjonalne pipeline’y stosują wzorce takie jak UPSERT, MERGE czy nadpisywanie partycji.

Najważniejsze wyzwania w procesach ETL

Jakość danych

Duplikaty w hurtowni oznaczają błędne raporty. Jeśli przychód naliczy się podwójnie, ktoś podejmie złą decyzję biznesową, a przy audycie finansowym mogą pojawić się poważne konsekwencje – łącznie z koniecznością korygowania sprawozdań.

Skalowalność i wydajność

W świecie chmurowym, przy wolumenach rzędu terabajtów dziennie, każda dodatkowa kopia danych to wymierne koszty składowania i przetwarzania. Wzorce takie jak partition overwrite są proste, ale generują koszt obliczeniowy proporcjonalny do rozmiaru partycji – przy częstych backfillach warto rozważyć granularniejsze partycjonowanie (np. godzinowe zamiast dziennego).

Obsługa błędów i klasyczne scenariusze awaryjne

Brak idempotentności ujawnia się najczęściej w trzech typowych scenariuszach:

- Problem ACK (potwierdzenia) – odbiorca pomyślnie zapisał dane, ale potwierdzenie zaginęło w sieci. Nadawca, działając zgodnie z semantyką at-least-once, wysyła te same dane ponownie. Bez deduplikacji po stronie odbiorcy powstają duplikaty.

- Manualne reruny – inżynierowie często ręcznie uruchamiają zadania w celu naprawy błędów lub uzupełnienia danych historycznych (backfill). W pipeline’ach typu append każde takie uruchomienie dubluje istniejące dane.

- Opóźnione duplikaty z kolejek – brokerzy komunikatów operują na zasadzie visibility timeout. Jeśli konsument nie zdąży potwierdzić wiadomości w określonym czasie, staje się ona ponownie widoczna i może być przetworzona równolegle przez innego workera.

Monitoring pipeline’ów

Niestabilne dane analityczne utrudniają budowę systemów fraud detection, scoringów ryzyka czy modeli ML, które opierają się na historycznie spójnym obrazie zachowań użytkowników. Każdy incydent ma też koszt ludzki – eskalacje on-call, kontekst switching, ręczne korekty – który kumuluje się w postaci dużego długu operacyjnego.

Wzorce zapewniające idempotentność

Idempotency Keys – deterministyczne klucze deduplikacyjne

Stabilny i unikalny identyfikator operacji generowany jak najbliżej źródła. Może to być identyfikator biznesowy (order_id) lub kryptograficzny hash z payloadu. System utrzymuje rejestr przetworzonych kluczy i przed wykonaniem operacji sprawdza, czy klucz już istnieje.

Dla systemów o dużym wolumenie stosuje się hybrydę – naturalny klucz biznesowy plus okno czasowe (TTL), aby ograniczyć rozmiar rejestru. Funkcja generująca klucz musi być odporna na drobne różnice techniczne (np. kolejność pól w JSON), w przeciwnym wypadku system staje się „prawie idempotentny” – formalnie działa, ale realnie przepuszcza duplikaty.

UPSERT / MERGE – naturalny wybór dla mutable encji

Najbardziej naturalny wzorzec dla relacyjnych baz danych i nowoczesnych hurtowni. Zamiast polegać na INSERT, który rzuca błędem przy duplikacie klucza, stosuje się logikę aktualizującą istniejący wiersz w przypadku konfliktu.

Partition Overwrite – prostota dla danych czasowych

Nadpisywanie całej partycji dla danego przedziału czasu – najprostszy do zrozumienia wzorzec, idealny dla batchowych faktów czasowych.

W nowoczesnych warstwach storage z formatami transakcyjnymi operacja overwrite jest atomowa z perspektywy czytelników, co dodatkowo zwiększa bezpieczeństwo. Głównym kompromisem jest koszt obliczeniowy: każde ponowne przeliczenie partycji to odczyt i zapis całego zakresu danych.

Transakcyjne okna czasowe i watermarking

W systemach przetwarzających dane w czasie rzeczywistym (streaming) idempotentność jest trudniejsza do osiągnięcia. Dane mogą przychodzić z opóźnieniem lub w nieoczekiwanej kolejności, więc system musi potrafić ponownie otworzyć już zamknięty przedział czasowy i zaktualizować wynik – a jednocześnie zapisać go do magazynu docelowego w sposób atomowy. Jeśli te dwa elementy nie są ze sobą zsynchronizowane, łatwo o sytuację, w której silnik strumieniowy „widzi” poprawne dane, ale hurtownia – nie.

Porównanie wzorców

| Wzorzec | Zastosowanie | Zalety | Wady |

| Idempotency Key | API, event-driven, kolejki | Precyzyjna deduplikacja zdarzeń | Wymaga magazynu kluczy |

| UPSERT / MERGE | Bazy danych, CDC, encje mutable | Zawsze aktualny stan | Kosztowne skanowanie kluczy |

| Partition Overwrite | Hurtownie, batch, logi | Najprostsza logika | Drogie przy częstych aktualizacjach |

| Transakcyjne okna | Streaming, real-time | Obsługa spóźnionych danych | Wysoka złożoność |

Testowanie idempotentności

Idempotentność należy traktować jak właściwość niefunkcjonalną, którą trzeba aktywnie testować, nie zakładać. Dobry zestaw testów powinien obejmować:

- Wielokrotne uruchomienia tego samego zadania z tą samą logiczną datą wykonania i porównanie checksum tabel docelowych między runami.

- Chaos engineering – celowe psucie środowiska: zabijanie procesów workerów w trakcie zapisu, latency injection, network partitioning, awarie w różnych fazach (przed zapisem, w trakcie transakcji, po częściowym zapisie). Wskaźnikiem sukcesu jest sytuacja, w której po automatycznym retry stan końcowy jest identyczny z wynikiem w warunkach idealnych.

- Fuzz testing wejść czasowych i payloadów – wysyłanie zdarzeń z odległymi timestampami (time skewing) oraz identycznych biznesowo rekordów z minimalnymi różnicami technicznymi (różna kolejność pól w JSON, dodatkowe białe znaki). Takie testy wymuszają budowę bardziej odpornych funkcji generujących klucze (np. poprzez sortowanie pól JSON przed haszowaniem).

Dobre praktyki projektowania pipeline’ów ETL

- Traktuj idempotentność jako wymaganie niefunkcjonalne klasy „must-have” dla każdego nowego pipeline’u, z jawną akceptacją ryzyka tam, gdzie świadomie odstępuje się od tej zasady.

- Zrezygnuj z surowych INSERT – każdy zapis powinien być UPSERT-em lub częścią transakcyjnego nadpisywania partycji.

- Stosuj klucze naturalne lub deterministyczne hashe (np. UUID, hash payloadu) zamiast wyłącznie kluczy autoincrement.

- Wyeliminuj funkcje czasu systemowego z transformacji – używaj logicznej daty orkiestracji jako jedynego źródła prawdy o dacie wykonania zadania.

- Egzekwuj idempotentność jak najbliżej „storage of truth” – w hurtowni lub lakehousie, zamiast polegać wyłącznie na właściwościach brokera kolejek.

- Standaryzuj testy idempotentności (wielokrotne runy, chaos engineering, fuzzing) jako część definition of done dla kluczowych pipeline’ów.

- Dokumentuj semantykę idempotentności na poziomie kontraktów między warstwami, tak aby było jasne, jakie gwarancje daje dany potok.

ETL czy ELT?

W nowoczesnych architekturach lakehouse coraz częściej spotykamy podejście ELT – dane są najpierw ładowane w surowej formie do warstwy surowej (append-only z identyfikatorami zdarzeń), a transformacje wykonywane są wewnątrz hurtowni. W warstwie pośredniej stosuje się MERGE, aby stworzyć spójny obraz encji, eliminując duplikaty. W warstwie agregatów biznesowych dane są przeliczane idempotentnie przy użyciu partycjonowania czasowego – co pozwala na łatwe poprawki logiki biznesowej i przeliczanie całych miesięcy bez ryzyka zaśmiecenia wyników.

Podsumowanie

Idempotentność w pipeline’ach ETL to nie luksus, lecz bezpieczeństwo. To różnica między systemem, który „może zadziała”, a systemem, na którym można polegać. Inwestycja w idempotentność od pierwszego dnia drastycznie zmniejsza dług technologiczny, koszty utrzymania i liczbę nocnych incydentów.

Jest w tym jeszcze jeden efekt, który widać dopiero z czasem. Zespoły, które konsekwentnie projektują pipeline’y z myślą o idempotentności, zaczynają inaczej podchodzić do danych – zamiast pytać „jakie kroki wykonać”, pytają „jaki stan chcemy osiągnąć”. To wymusza lepsze nawyki: porządne code review, wersjonowanie logiki transformacji i solidniejsze testy. W rezultacie łatwiej wprowadzać zmiany, bo wiadomo, że pipeline można bezpiecznie przeliczyć od nowa.